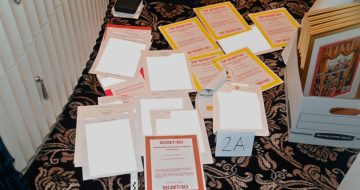

Los investigadores aplicaron la metodología de un ladrón de identidades, recopilando imágenes de voluntarios a través de sus cuentas sociales.

Por Marcos Merino

Ciudad de México, 21 de agosto (SinEmbargo/Ticbeat).- Pese a los significativos avances logrados en el campo del reconocimiento facial en los últimos años, lo cierto es que nos encontramos ante una tecnología propensa (como ya descubrió Google tras la polémica generada cuando Google Photos identificó como «gorilas» a dos usuarios afroamericanos), algo inaceptable cuando se busca conceder a esta tecnología un mayor peso a la hora de diseñar sistemas de seguridad.

Ahora, un equipo de investigadores de la Universidad de Carolina del Norte ha logrado mostrar todo el camino que le queda aún al reconocimiento facial hasta situarse al nivel de desarrollo que se espera del mismo. Para ello, han demostrado que un significativo porcentaje de los actuales sistemas de seguridad basados en esta tecnología pueden ser engañados usando rostros en 3D, creaciones de realidad virtual elaboradas a partir de fotos recopiladas en perfiles de Facebook.

Los investigadores seleccionaron a 20 voluntarios y aplicaron sobre ellos la metodología de un acosador o ladrón de identidades cualquiera: reunieron fotos de todas las fuentes online que pudieron recopilar, y a partir de las mismas (y añadiendo sombras y texturas allí donde el material fotográfico no permitía reproducirlas) crearon modelos en 3 dimensiones a los que sólo tuvieron que añadir expresiones faciales y ajustar sus ojos para que pareciera que estaban mirando a cámara. Cabe destacar que varios de esos voluntarios eran especialistas en seguridad, concienciados -por lo tanto- acerca de su privacidad, por lo que los investigadores sólo tuvieron acceso en algunos casos a unas pocas fotos suyas de baja calidad.

Este experimento se testó con 5 sistemas de seguridad diferentes. ¿Los resultados? 4 de los mismos fueron engañados entre un 55 por ciento y un 85 por ciento de las veces. Entre las posibles soluciones a esta vulnerabilidad, los investigadores proponen añadir una capa adicional de seguridad a través de la detección de radiación infrarroja (que un rostro real sí emitiría).