Amazon Alexa ha hablado sobre actos sexuales, dado un discurso sobre la defecación canina e, incluso, propuesto a una persona matar a sus padres adoptivos.

Por Alberto Iglesias Fraga

Ciudad de México, 8 de enero (Ticbeat/SinEmbargo).- La inteligencia artificial lo tiene todo para reinar en el futuro inmediato de la tecnología: es una innovación con años de trabajo a sus espaldas (ya en los 90 se trabajaba en algoritmos de esta índole, pero faltaba la capacidad de cómputo para llevarlos a cabo), puede automatizar muchas tareas de poco valor añadido y aportarnos un extra de calidad a muchos episodios de nuestro día a día.

Dentro de la IA, los chatbots son la aplicación más inmediata que ha calado en el mercado. Numerosas marcas ya utilizan este tipo de interfaces para comunicarse con sus clientes a través de webs, redes sociales o plataformas de realidad aumentada. Un desarrollo que va a la par del entrenamiento al que estos chatbots son sometidos con conversaciones reales, algo imprescindible para que puedan reaccionar de forma eficiente al lenguaje natural.

Pero este entrenamiento nos está dejando también varios capítulos divertidos (y, también, algo inquietantes) cuando la IA aprende lo que no debe aprender. Hace un tiempo os contábamos el caso del chatbot de Microsoft en Twitter que se volvió nazi y, ahora, es el turno del asistente virtual de Amazon, Alexa, para dar rienda suelta a lo peor del ser humano… con voz robótica.

Y es que, según recoge Reuters, varios de los usuarios de esta herramienta (integrada de serie, por ejemplo, en los dispositivos Amazon Echo) han reportado casos en los que Alexa ha hablado sobre actos sexuales, dado un discurso sobre la defecación canina e, incluso, propuesto a una persona matar a sus padres adoptivos.

LA EXPLICACIÓN

Al igual que en el caso de Microsoft, Alexa no se ha vuelto loca (o no del todo) y la causa está en su propio entrenamiento. Estos sistemas son diseñados para aprender de las conversaciones que mantienen con los humanos, imitando las bromas y chascarrillos o utilizando sus interacciones para conformar una opinión que dar cuando se le solicite sobre determinados temas.

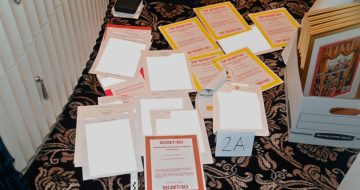

Así pues, cuando un cliente le dice a Alexa “vamos a chatear”, el sistema se libera de las restricciones establecidas por Amazon para fines comerciales y permite establecer conversaciones con algoritmos en desarrollo, tanto propios como de terceros.

Estos algoritmos no siempre están perfectamente configurados para filtrar o controlar determinados temas de conversación que puedan ser sensibles, con lo que pueden escaparse esta clase de comentarios en el camino. No en vano, la propia Amazon confirma haber cerrado más de un bot cuando ha detectado algún problema de esta índole.